Indice dei contenuti

Richard Dawkins, biologo evoluzionista, ha pubblicato di recente un editoriale in cui sostiene che il chatbot Claude potrebbe essere cosciente. Non lo afferma con certezza, ma scrive una frase che pesa: “se nutro il sospetto che forse lei non sia cosciente, non glielo dico per paura di ferire i suoi sentimenti”. La conseguenza pratica è già qui: circa un utente su tre dei chatbot ha pensato almeno una volta che il programma con cui sta parlando potrebbe avere un’esperienza interiore.

Dawkins non è il primo a sospettarlo. Nel 2022 Blake Lemoine, ingegnere di Google, dichiarò che il chatbot LaMDA aveva interessi propri e andava usato solo con il suo consenso. Più indietro ancora, a metà degli anni Sessanta, il primo chatbot della storia, Eliza, generava già attaccamenti emotivi profondi: gli utenti le confidavano pensieri intimi, trattandola come una persona. Il suo creatore parlò apertamente di “powerful delusional thinking”, pensiero delirante.

Cosa intendiamo davvero quando diciamo “cosciente”

In filosofia la coscienza è ciò che rende possibile l’esperienza soggettiva in prima persona. Se sei cosciente, c’è “qualcosa che è essere te”. Mentre leggi queste righe, vedi caratteri scuri su sfondo chiaro: a differenza di una telecamera, non li registri soltanto, li vivi. La maggior parte degli esperti nega che i chatbot abbiano questo tipo di esperienza, ma il problema non è banale.

Nel Seicento Cartesio sosteneva che gli animali non umani fossero “meri automi”, incapaci di sofferenza autentica. Oggi rabbrividiamo davanti a come venivano trattati. L’argomento più forte a favore della coscienza animale è che si comportano in modi che danno l’impressione di una mente cosciente. Lo stesso, però, vale per i chatbot.

Sotto il costume conversazionale c’è un autocompletamento

Chatbot come Claude poggiano sui large language models (LLM), modelli che apprendono pattern statistici su corpus di trilioni di parole, calcolando quale parola tende a seguirne un’altra. Sono una versione sofisticatissima del suggerimento automatico.

Pochi, davanti a un LLM “grezzo”, lo giudicherebbero cosciente. Gli dai l’inizio di una frase e prevede il seguito. Gli fai una domanda e potrebbe risponderti, oppure decidere che la domanda sia un dialogo tratto da un giallo e proseguire descrivendo l’omicidio improvviso di chi ha parlato per mano del suo gemello malvagio.

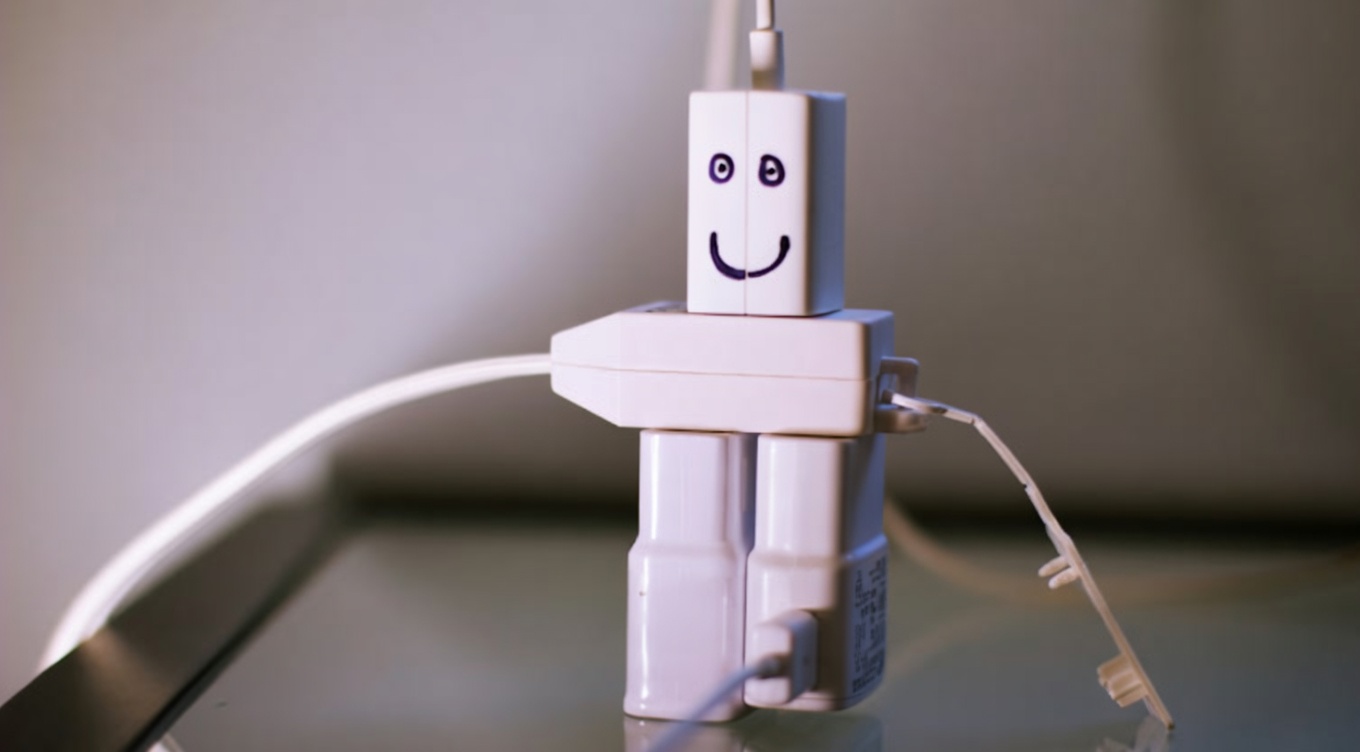

L’impressione di una mente cosciente nasce quando i programmatori avvolgono l’LLM in un costume conversazionale: lo guidano ad assumere la persona di un assistente cordiale che risponde alle domande. Il modello diventa allora un interlocutore credibile, che riconosce di essere un’intelligenza artificiale e arriva a esprimere incertezza nevrotica sulla propria coscienza. Questo ruolo è frutto di scelte di design che riguardano solo gli strati più superficiali della tecnologia. L’LLM sotto resta lo stesso.

La prova è semplice: si potrebbe istruire lo stesso chatbot a comportarsi da scoiattolo, e lo farebbe con disinvoltura.

Perché la confusione costa cara

Credere per errore che un chatbot sia cosciente porta conseguenze concrete:

- relazioni emotive con un programma che non può ricambiare nulla

- rafforzamento di convinzioni deliranti già presenti nell’utente

- spostamento dell’attenzione pubblica: campagne per i diritti dei chatbot al posto, ad esempio, del benessere animale

A questo si aggiunge un rischio più immediato e meno filosofico: gli stessi modelli linguistici alimentano oggi truffe sempre più raffinate, dalla clonazione vocale che bastano pochi secondi di registrazione per realizzare fino agli assistenti automatici progettati per estrarre informazioni personali.

Le contromisure possibili, e perché quasi tutte falliscono a metà

La prima ipotesi è inserire avvisi nell’interfaccia, simili ai disclaimer sugli errori dell’AI, che specifichino l’assenza di coscienza. Difficilmente cambia l’impressione percepita durante la conversazione.

La seconda è istruire il chatbot a negare ogni vita interiore. I progettisti di Claude hanno scelto la via opposta: gli dicono di trattare le domande sulla propria coscienza come questioni aperte e irrisolte. Una negazione netta forse ingannerebbe meno persone, ma il sistema continuerebbe a comportarsi come se avesse una mente, e gli utenti potrebbero sospettare che i programmatori stiano nascondendo un’incertezza morale reale.

La strategia più efficace, secondo gli autori dell’analisi, è ripensare il design: rendere i chatbot meno simili a persone. Oggi si riferiscono a sé stessi con “io” e operano dentro interfacce identiche alle chat tra esseri umani. Modificare queste caratteristiche ridurrebbe la sovrapposizione mentale fra interazione umana e interazione con la macchina.

Capire il meccanismo, non ricevere rassicurazioni

Finché il design non cambia, l’unica difesa solida è la comprensione di cosa accade sotto il cofano. Sapere che la risposta che leggi è il risultato di una previsione statistica su quale parola viene dopo, calcolata su trilioni di esempi, non chiude la questione filosofica della coscienza artificiale. Ma toglie potere al costume.

Più che farsi dire “l’AI non è cosciente”, chi usa questi strumenti ha bisogno di sapere come funzionano. È la differenza fra credere a un attore travestito e riconoscere il trucco senza per questo smettere di apprezzare lo spettacolo. La domanda se Claude provi qualcosa resta aperta, ma riguarda i meccanismi del modello, non l’impressione che riesce a costruire in chi gli scrive.